湛江市网站建设_网站建设公司_百度智能云_seo优化

2026/1/17 18:22:10

网站建设

项目流程

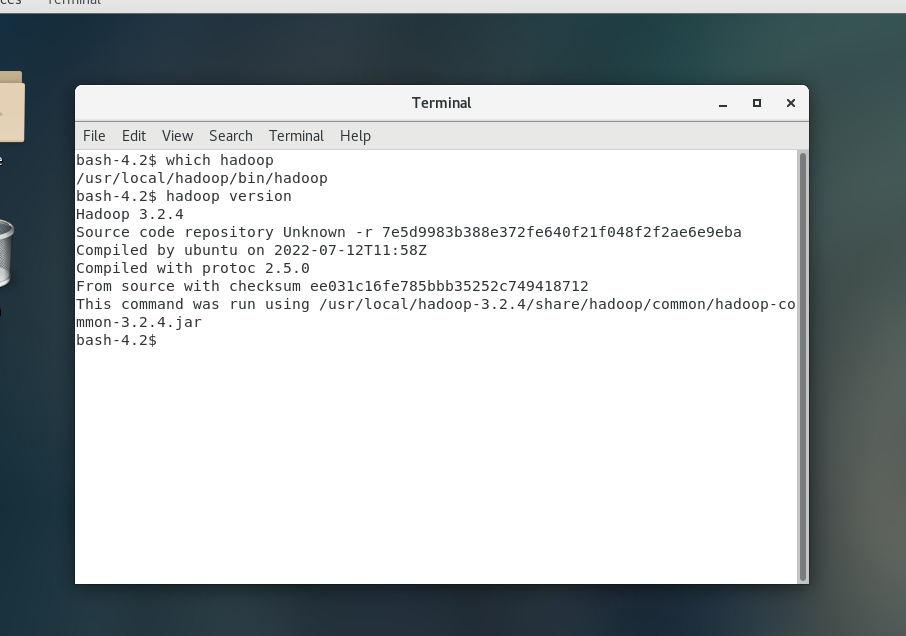

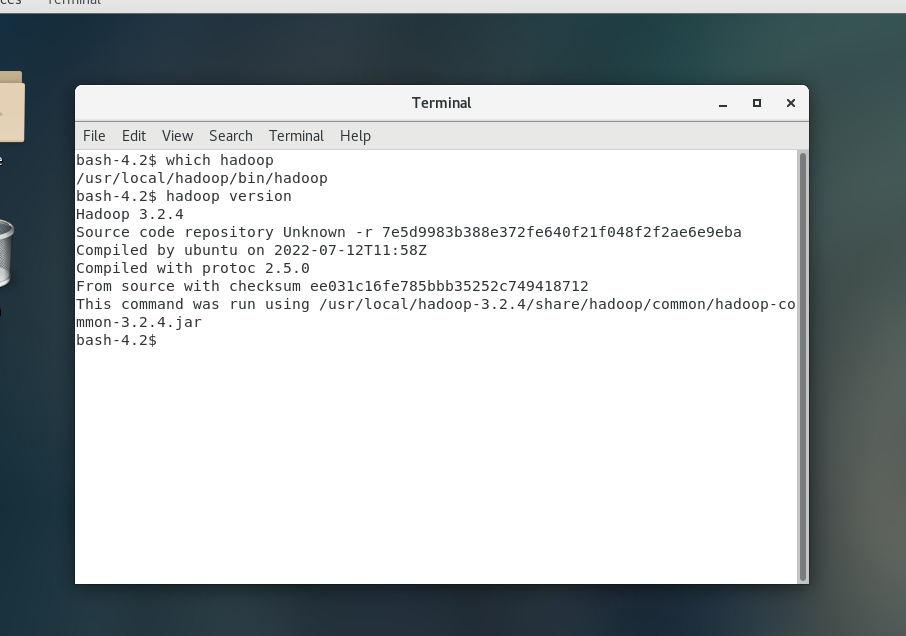

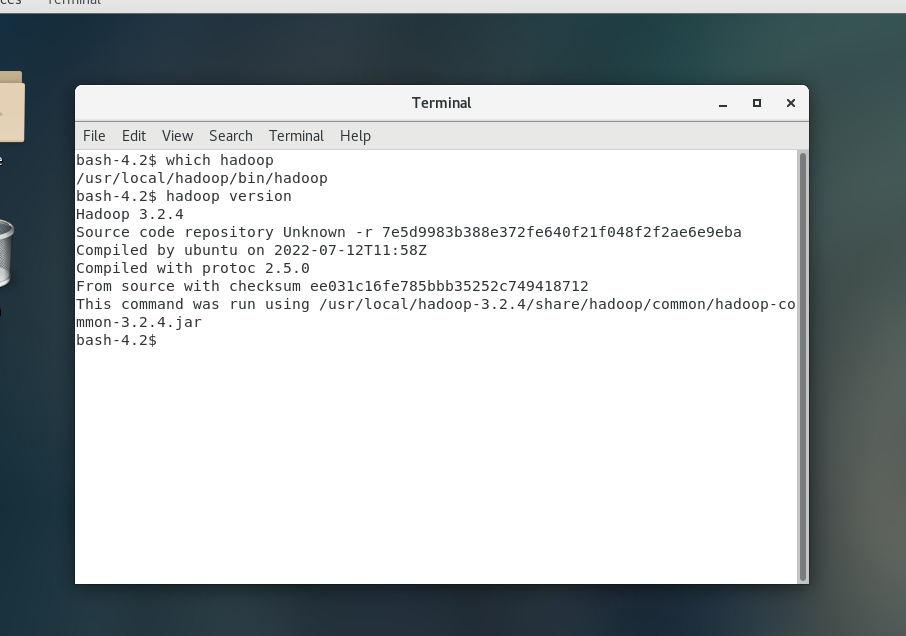

1.安装 Hadoop 和 Spark

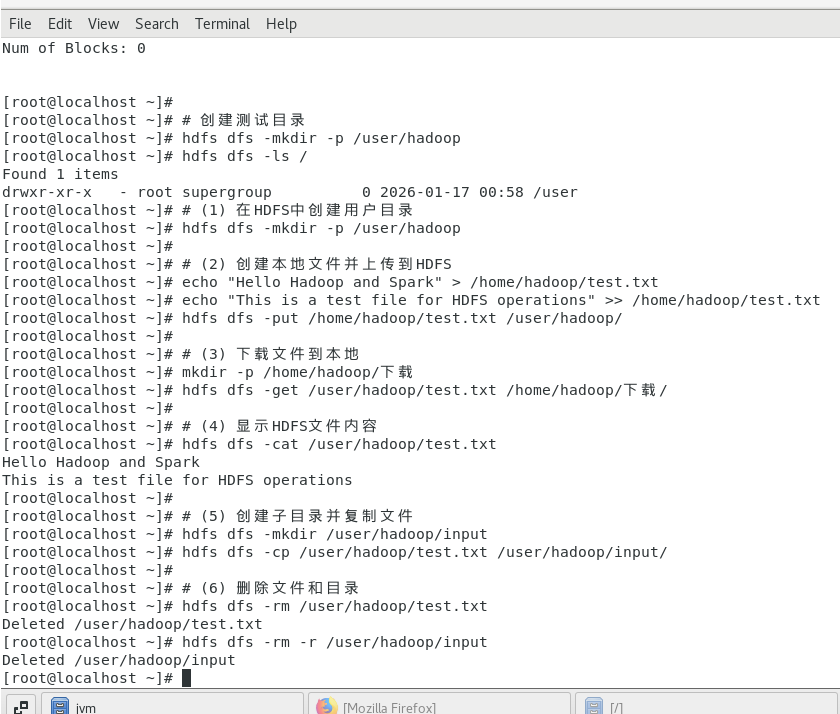

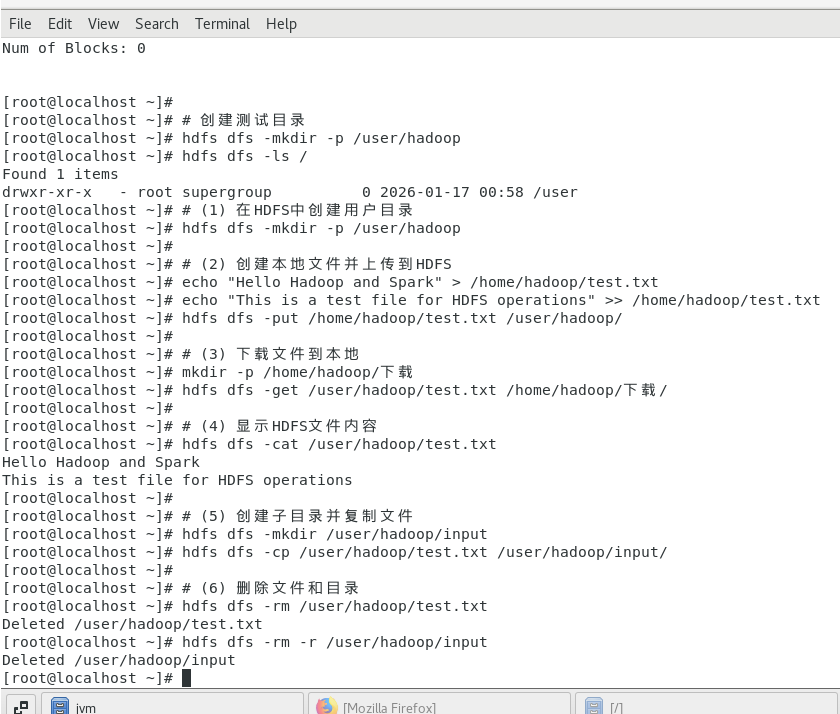

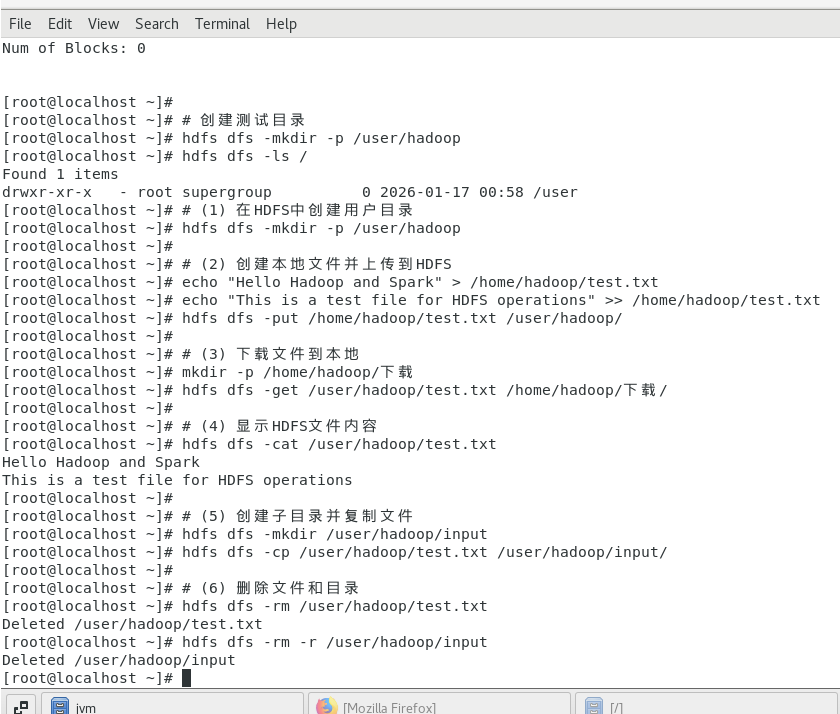

2.HDFS 常用操作

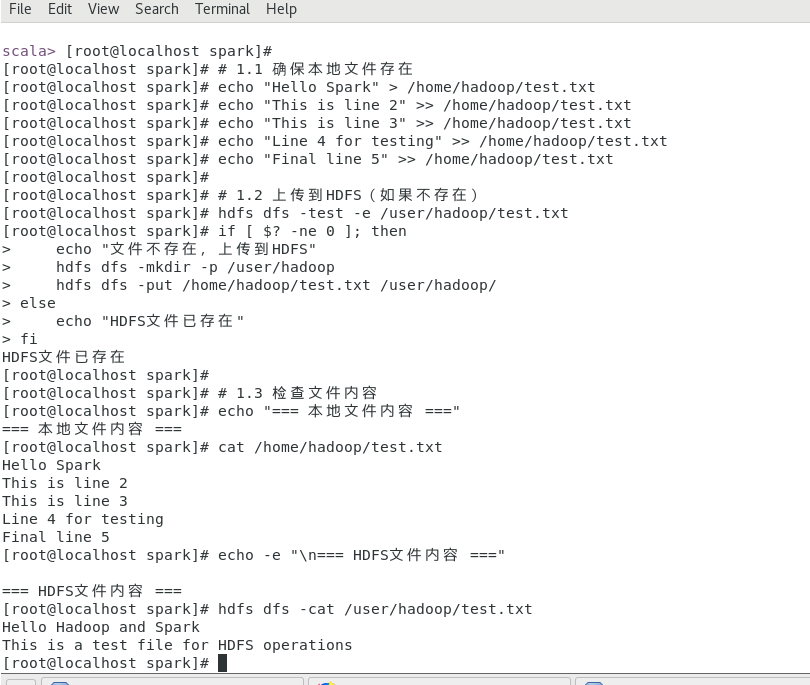

3. Spark 读取文件系统的数据

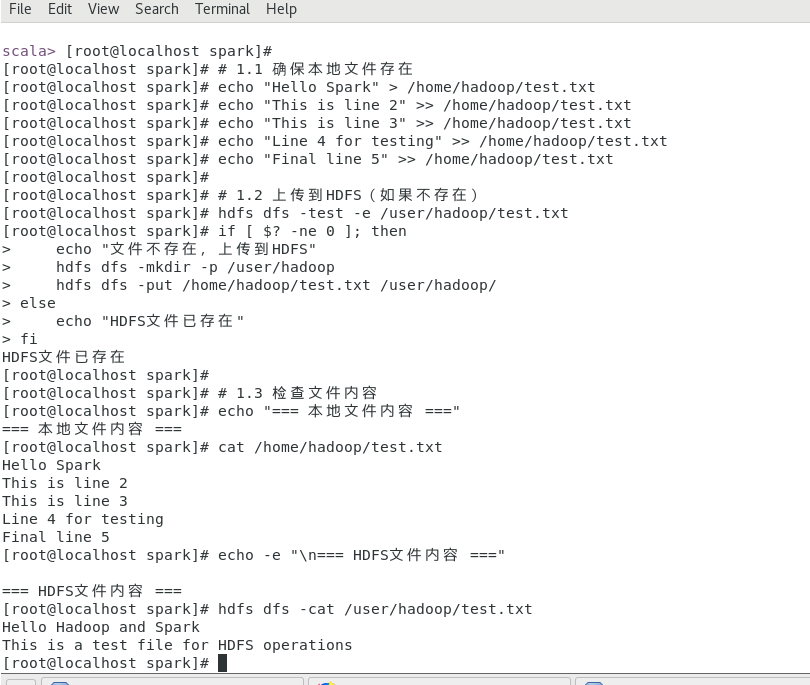

准备工作

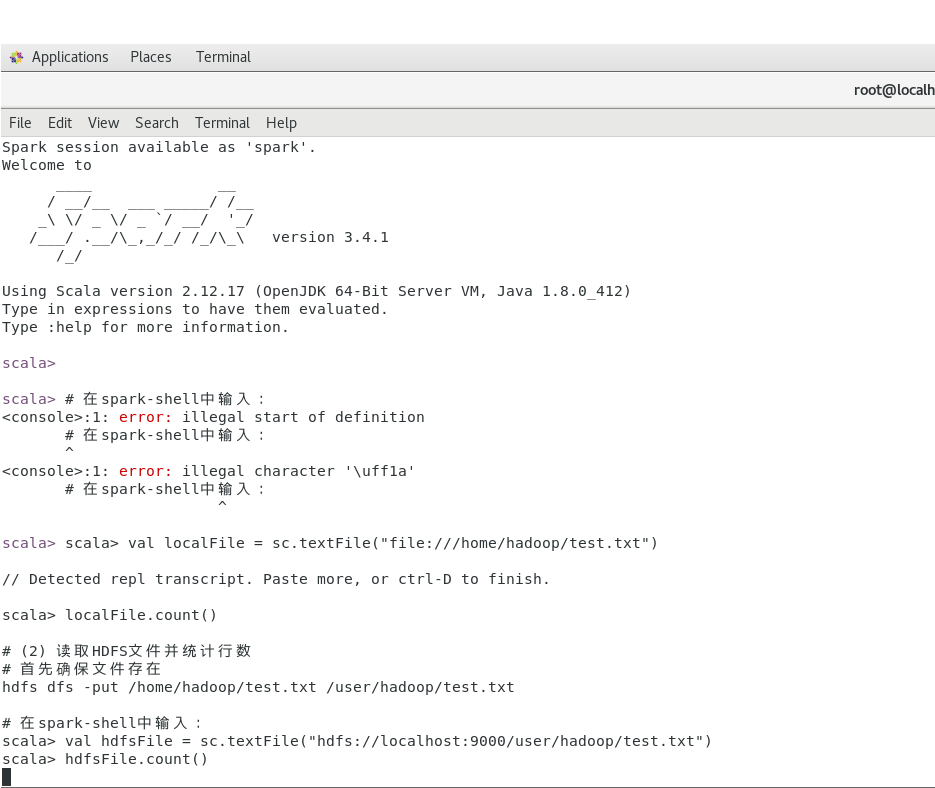

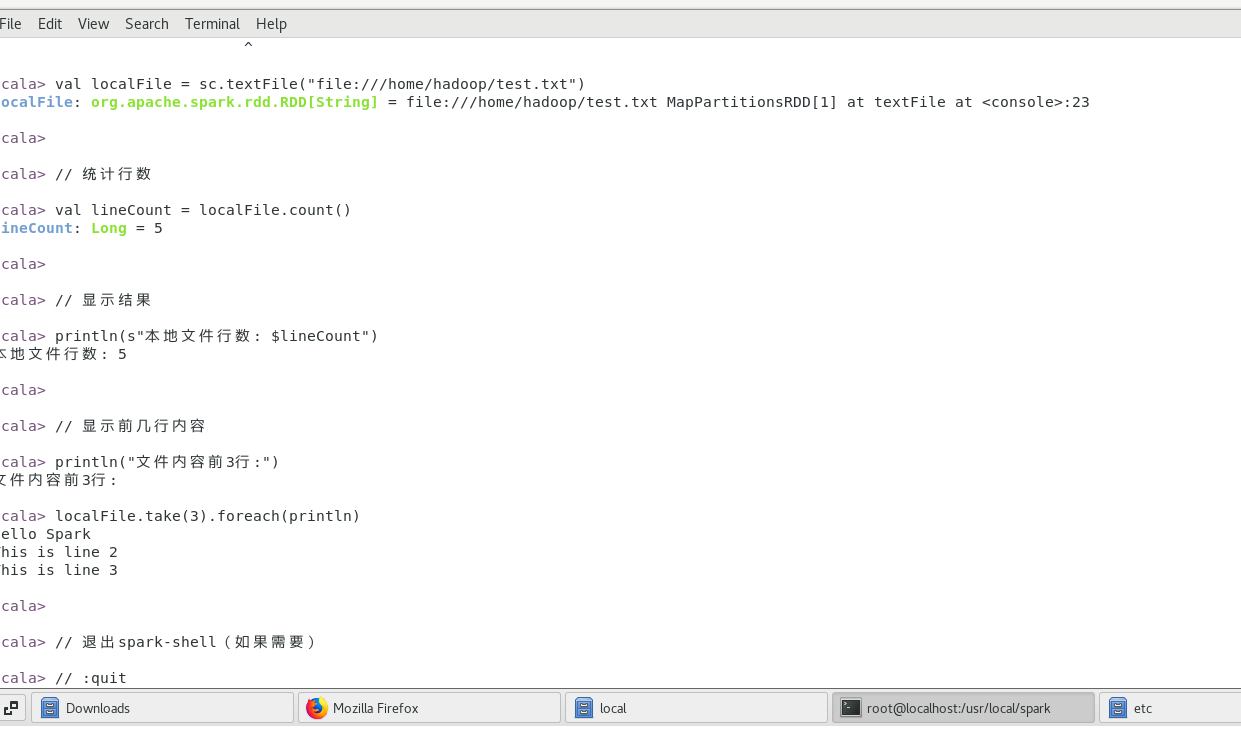

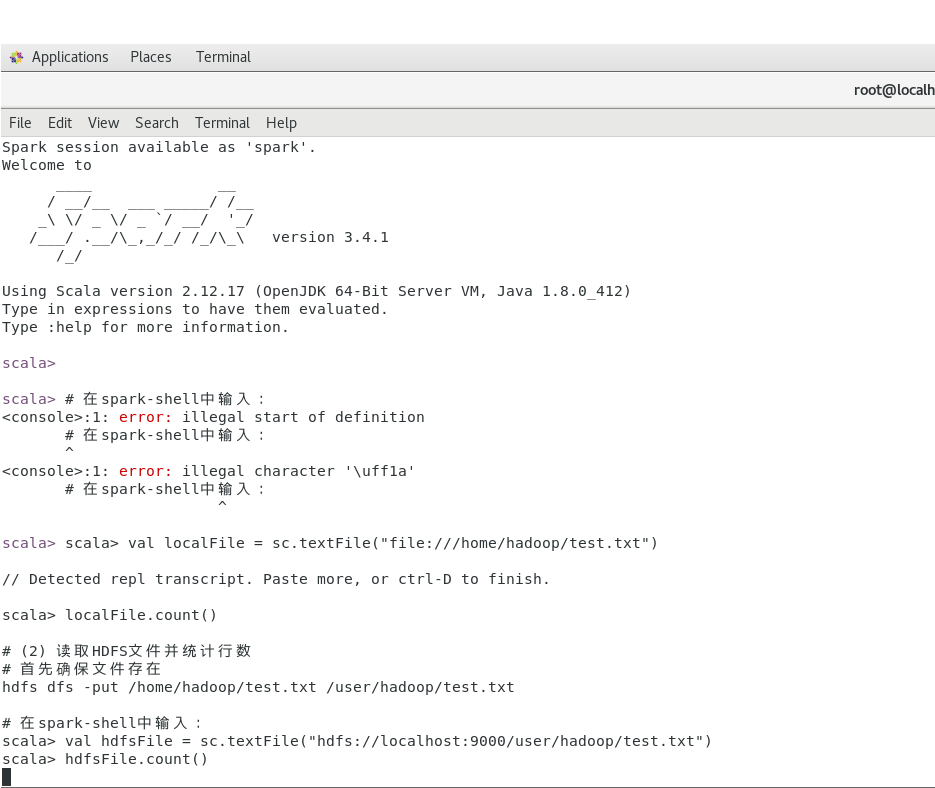

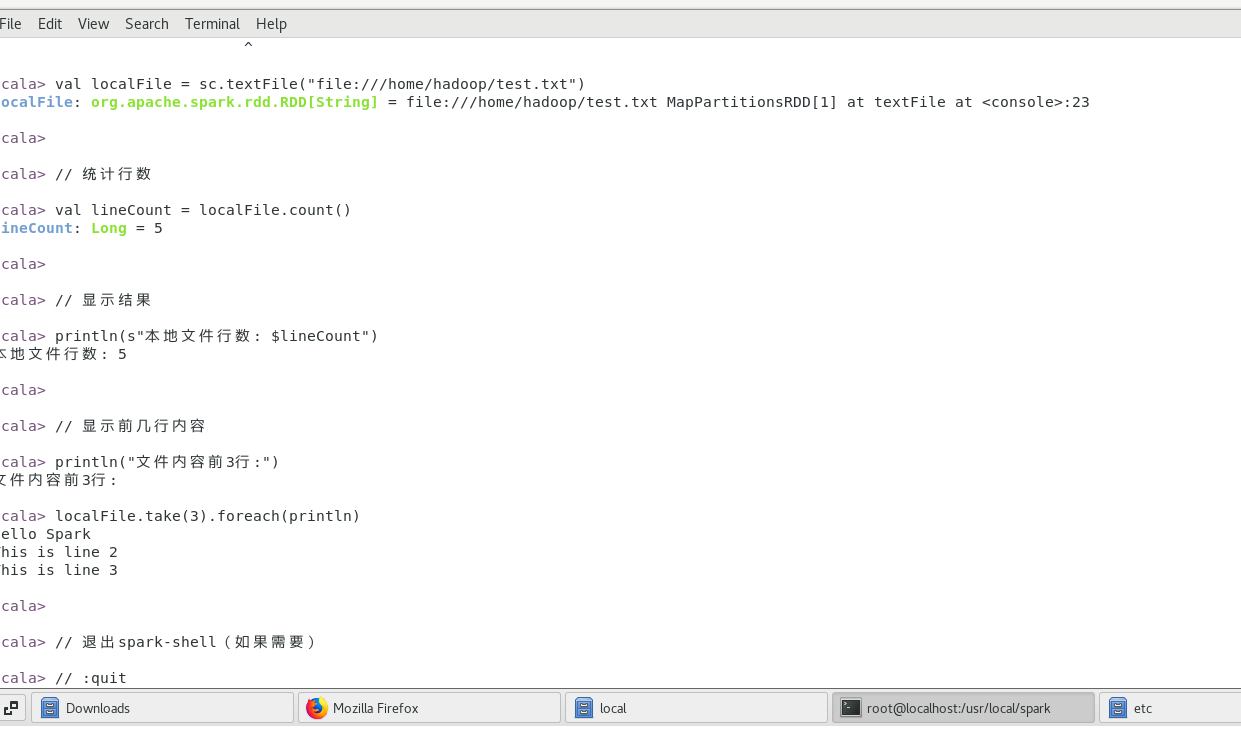

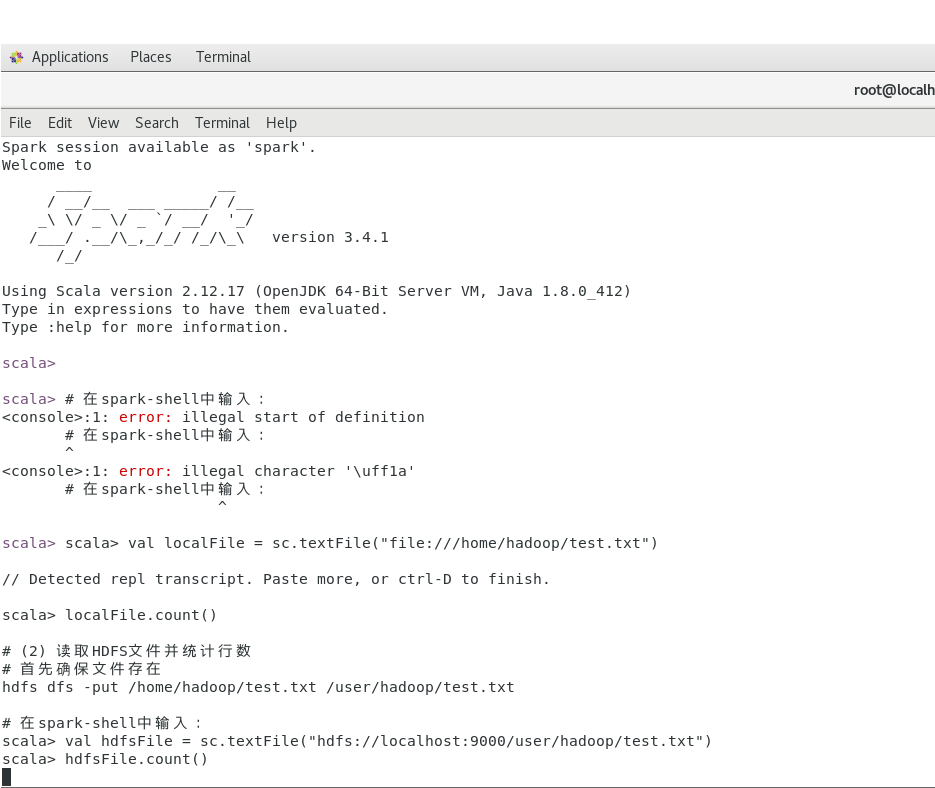

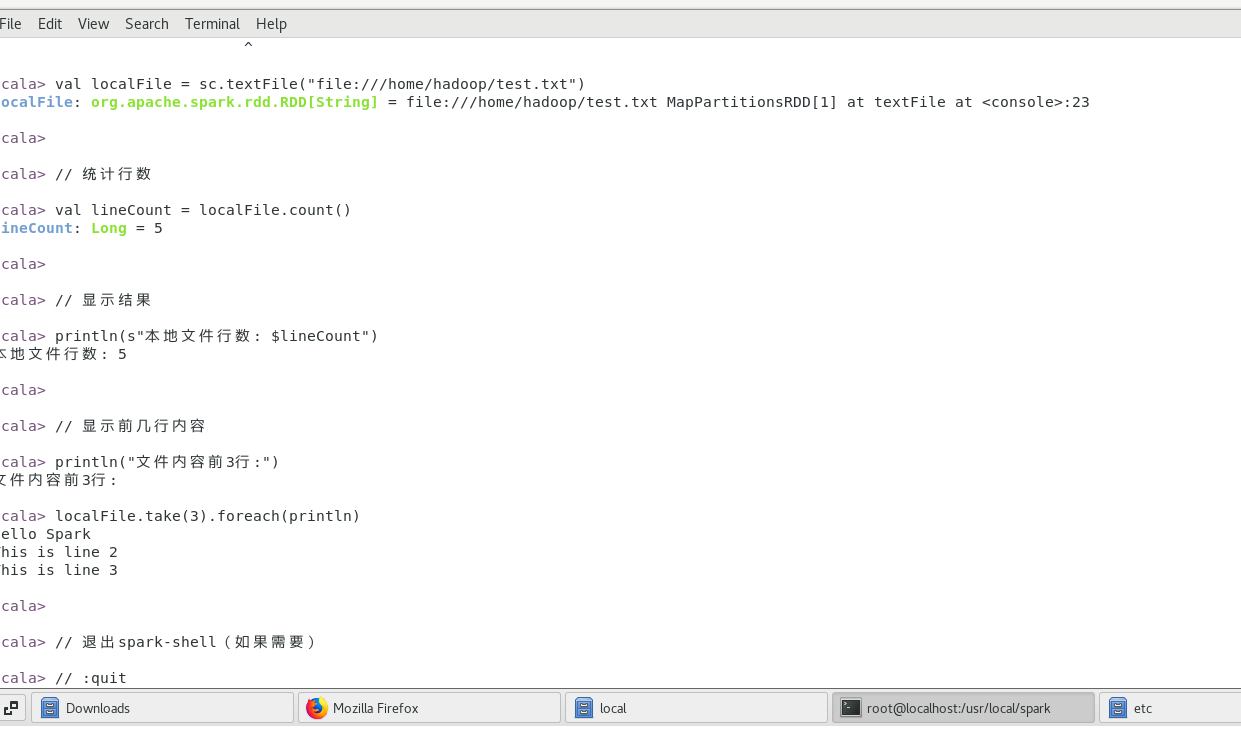

(1)在 spark-shell 中读取 Linux 系统本地文件“/home/hadoop/test.txt ”,然后统计出文件的行数;

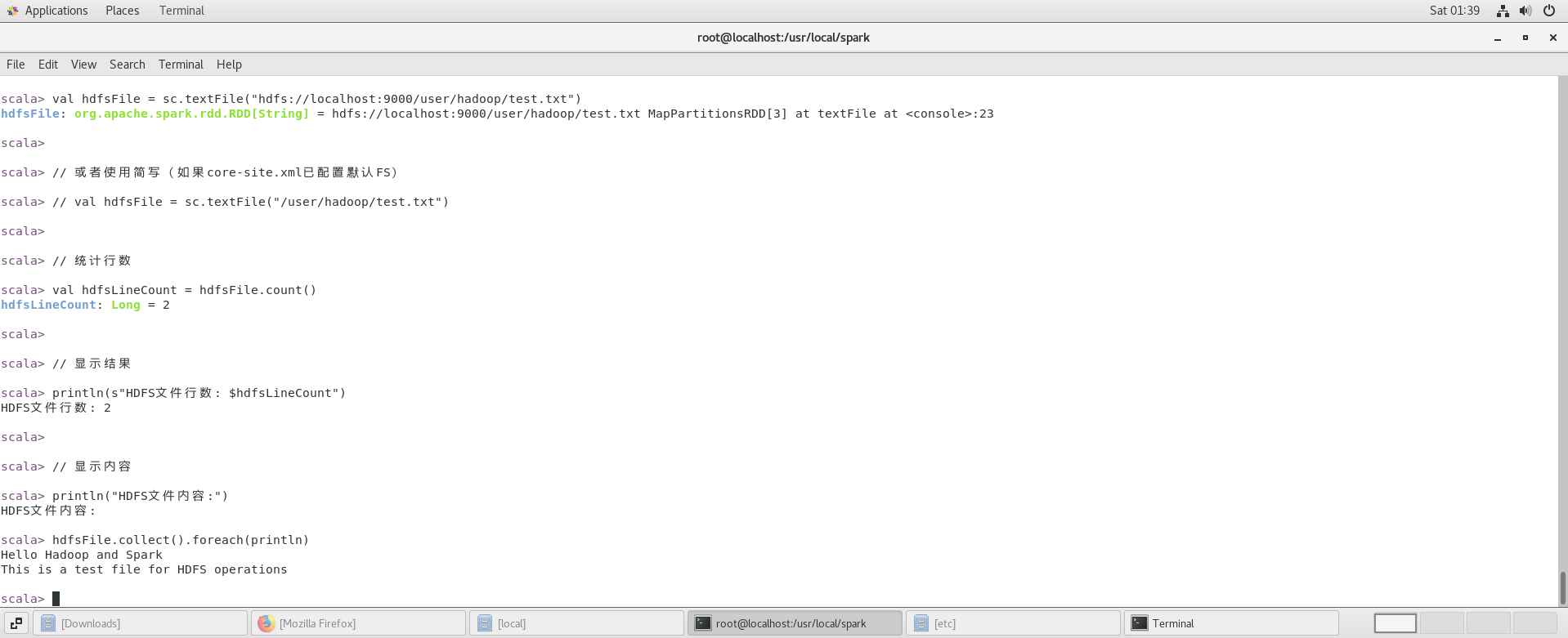

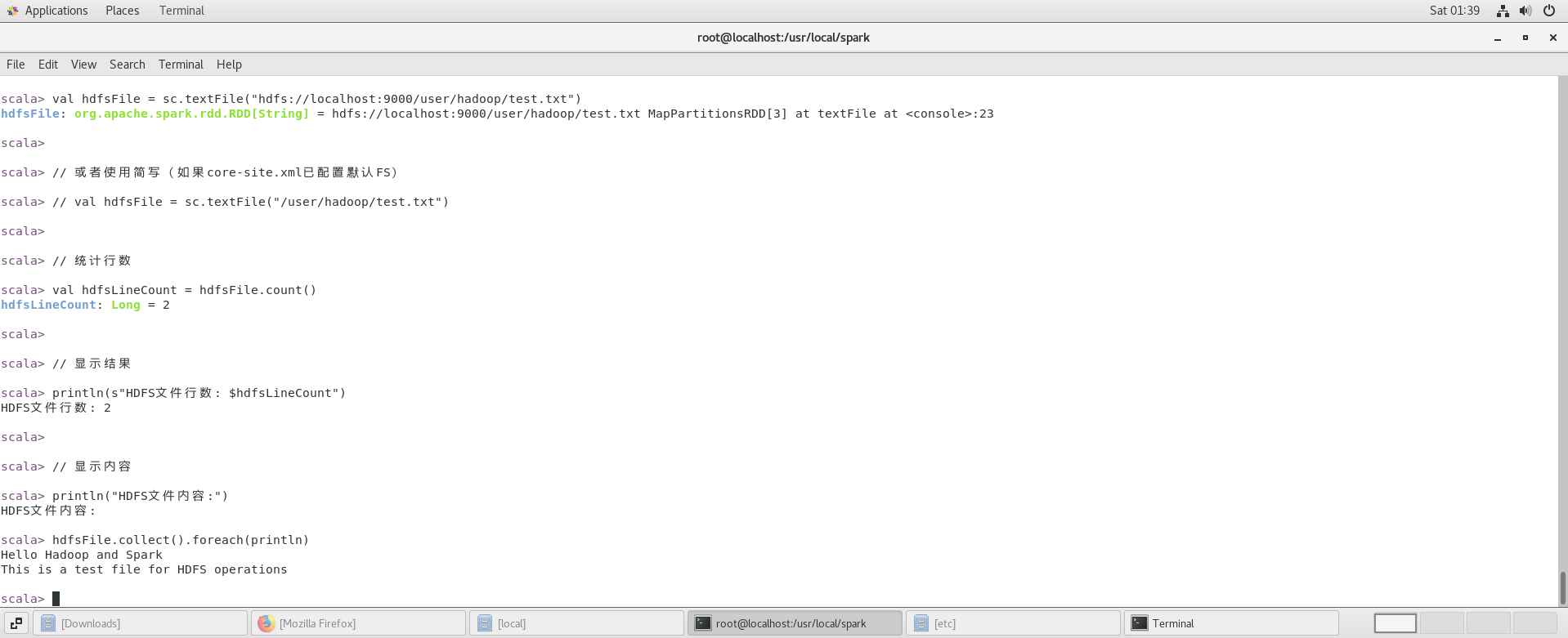

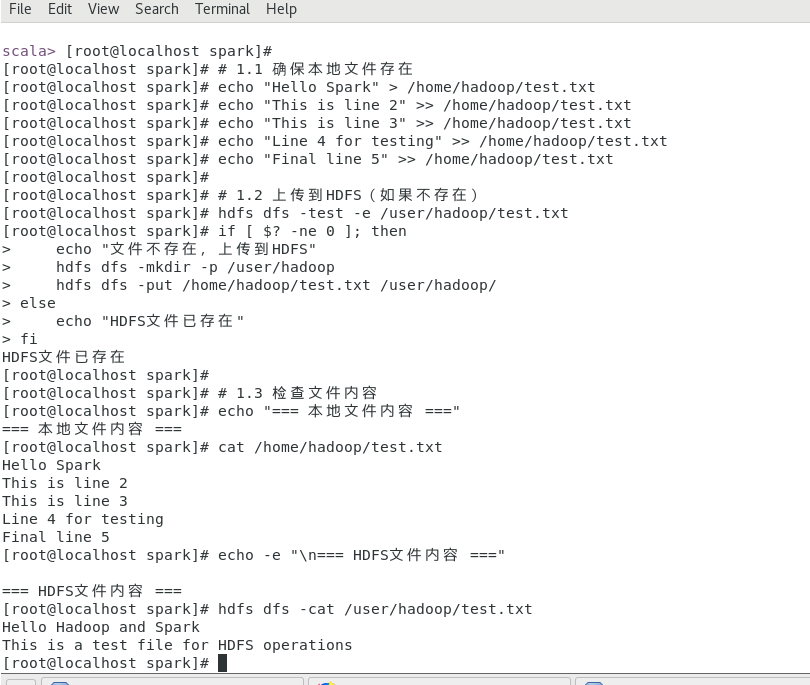

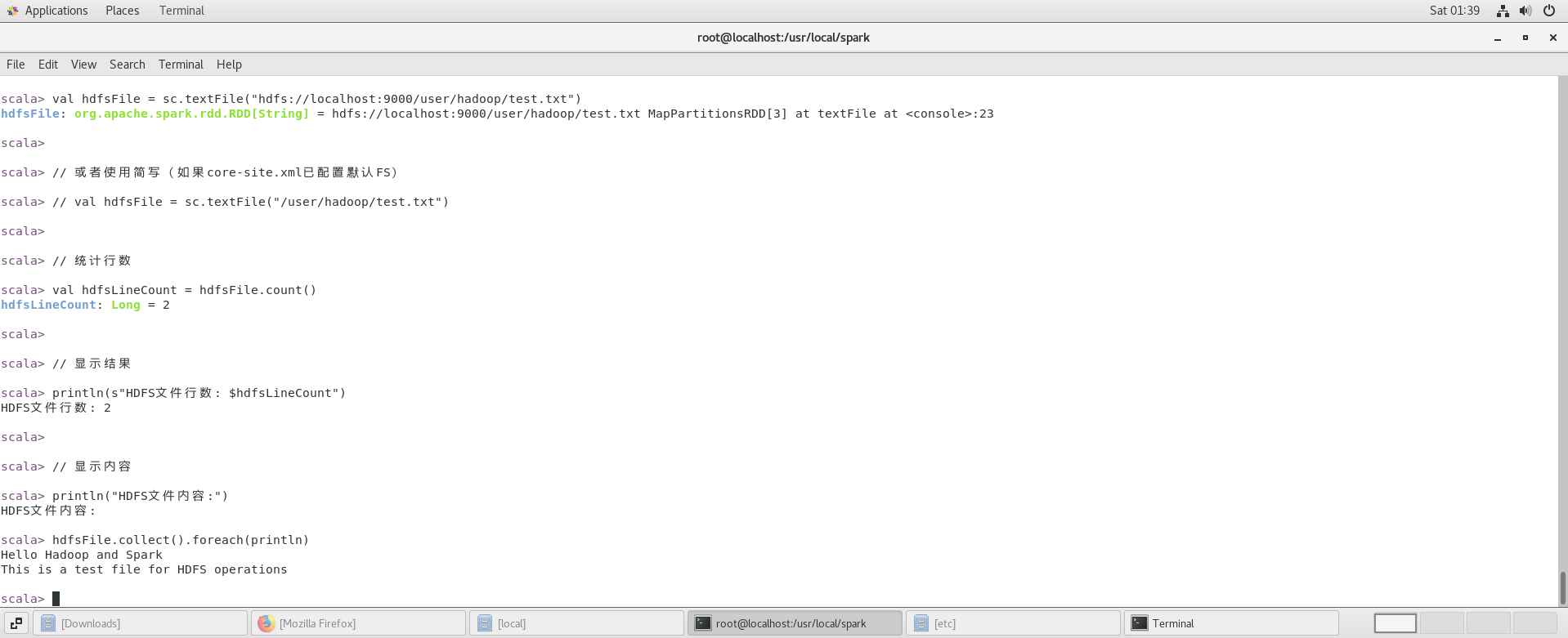

(2)在 spark-shell 中读取 HDFS 系统文件“/user/hadoop/test.txt ”(如果该文件不存在,请先创建),然后,统计出文件的行数;

(3)编写独立应用程序,读取 HDFS 系统文件“/user/hadoop/test.txt ”(如果该文件不存在,请先创建),然后,统计出文件的行数;通过 sbt 工具将整个应用程序编译打包成 JAR 包,并将生成的 JAR 包通过 spark-submit 提交到 Spark 中运行命令。

需要专业的网站建设服务?

联系我们获取免费的网站建设咨询和方案报价,让我们帮助您实现业务目标

立即咨询